几千年来,人类的伦理道德问题,从神学著作,到康德的纯粹哲学理论争辩,很难用简单的公式去表达。在标准版的电车问题中,一辆有轨电车失去了控制,即将造成五人死亡。有轨电车可以通过改变铁轨上的道岔来改变方向。然而,这样会导致一名工人被重新改变了方向的电车撞死。为了挽救五个人的生命而使铁轨改道,从而造成一名工人的死亡,在道德上是否允许?根据康德的观点,如果不改变电车的方向,任何人都不能为了救那五个人而危害那一位工人。从功利主义的观点来看,一个人必须考虑他的行为的后果和总效用,即对大多数人来说有最大的好处,因此他必须改变电车的方向。伦理理论最终导致了不同的解决方案。

随着人工智能技术与理论的进步,其道德伦理问题也被推进更富有争议的话题:

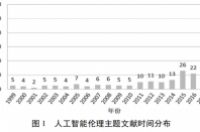

从1999-2018 年的 Web of Science数据库(以下简称WOS数据库)中,无论是以“人工智能伦理”为主题的文献还是以“机器人伦理”为主题的文献都呈现出显著的增长趋势。特别是近十年来,相关文献出现了井喷式增长1999 至 2015 年文献量的总和。这样高速的增长趋势,表示出越来越多的学者意识到人工智能伦理研究对于社会发展的重要意义与积极作用,探索人工智能伦理研究的知识情报有助于人工智能产业以及人类社会的健康发展。

(来源:WOS数据库)

(来源:WOS数据库)

机器人的英文单词是“Robot”, 最早由捷克作家卡雷尔·恰佩克在其科幻作品中首创, 原意是“农奴式被强迫的劳动者”。2017年8月21日,人工智能公司的 116 位创始人和首席执行官们,给联合国写了一封公开信,希望禁止“杀手机器人(即自动化武器,如无人机、无人战车、哨 兵机器人、无人驾驶军舰等)”的研发与使用。他们认为,这些机器人有成为恐怖武器的可能。独裁者和恐怖分子有可能利用这些武器对无辜人群使用,或以其他不可取的方式使用。

然而,2017年10月15日,英国政府在发布的《英国发展人工智能》报告中指出,人工智能具有改善教育医疗保健、提高生产力的巨大潜力,该报告从数据、技术、研究以及政策的开放与投入等方面,对人工智能发展提出了18条建议,意欲使英国成为人工智能的世界领导者。英国不是唯一重视人工智能大战的国家,各国都在热情的拥抱这一项技术,每项技术发明都饱负争议,历史告诉我们,技术进步确实让人类生活更加的自由了。

人工智能的善恶到底该如何评价?我们应当以何种态度对待人工智能的发展?

学术界有关人工智能道德判断的争论人工智能的道德判断需要区分两个问题 :其一,人工智能本身的道德评价问题;其二,人工智能研发与应用后果的善恶评价问题。对人工智能进行道德判断的关键问题没有解决,即未对人工智能本身善恶评价问题,与人工智能的研发与应用所带来的后果的善恶评价问题进行区分。后一问题解决的关键还是在人类自身。但是前一问题的解决,我们就不能基于现有的伦理道德框架对其进行评判,而应对传统的科技伦理进行批判性反思。

[1]目前有关人工智能的善恶评价可谓此起彼伏,莫衷一是。

总体而言,学术界主要存在以下三种立场与观点:

第一种乐观主义立场。

持此种立场的专家学者认为,人工智能只是一项手段与工具,本身无所谓“善与恶”“好与坏”,关键在于使用它的人类本身,对人工智能的未来发展前景持乐观主义态度,总体而言,人工智能的研发与广泛应用对人类发展利大于弊,能产生巨大的经济效益与社会效益。

一般而言,乐观主义立场大多是由一些与人工智能研发与应用相关,或出于自身利益考虑的人工智能界人士,或出于对科学技术盲目崇拜的科学主义者所坚持的,其缺陷在于片面地、孤立地看待人工智能的积极方面,比如能够产生巨大的经济与社会效益,重构包括金融、医疗、教育、交通等几乎所有的行业,从而推动人类生活方式的整体变革。他们有意或无意地忽视或者掩盖人工智能的消极作用,比如杀人机器人的诞生将会给人类带来安全威胁以及人类过度依赖人工智能文明可能造成人类文明的退化问题,等等。

第二种中立主义立场。

持此种立场的专家学者承认人工智能本身存在“作恶”的可能,它的研发与应用对人类具有潜在威胁,可能带来严重后果,但基于一些理由仍大力支持发展人工智能技术。

人工智能目前尚处于发展的初级阶段,其危害远远不够强大,所以不必过分担忧;

例如,人工智能领域的全球领衔分析师汤姆·奥斯汀表示,霍金等“彻底开发人工智能会导致人类彻底毁灭”的警告是“非常愚蠢”的,其理由在“现在人工智能还很低级”。

“人造的东西不可能超过人”;

这一观点源于某种宗教情怀,即“造物主一定比所造之物高明”,所以不用杞人忧天。令人讽刺的是,本该最具无神论精神的科学主义者,却从宗教信念中寻求思想资源。

“人类可以设定人工智能的道德标准”,但是从未对“人工智能必然会服从人类设定的道德标准”提供过有效的论证;

还有人认为只要对人工智能进行道德教育,就可以保证他们一心向善,全心全意为人类服务。然而,问题是道德教育如何能够防止人工智能 朝不道德方向发展。

第三种悲观主义立场。

持此种立场的专家学者认为,人工智能不再是工具地位,自身具有生命意识与学习能力,在道德上具有“作恶”的两种可能:一种是人工智能的强大威力可能引发“人类作恶”,另一种是人工智能自身具有“作恶”的能力,而且人类对人工智能的“作恶”无法应对,最终将使人类走向虚无与毁灭。因此,他们表达了人工智能将来有可能失控或危害人类的担忧。2015年初,史蒂芬·霍金、比尔·盖茨和埃隆·马克斯等人签署了一封公开信,呼吁控制人工智能开发。马克斯认为人工智能会“唤出恶魔”,比核武器对人类的威胁还大。霍金则明确断言:彻底开发人工智能可能导致人类灭亡。持悲观主义立场的人认为,技术并非使人类获得解放的道路,它“并非通过控制自然而从自然中解放出来,而是对于自然和人本身的破坏,不断谋杀生物的过程将最终导致总体毁灭”。

总结:

科技伦理是人类为了避免或减少科技滥用给自己带来的“负面”作用,从而为人们的科技行为制定出一套规范和一定的限制,以限制其发展的限度。这种观点只是简单粗暴地从既定的伦理道德立场出发,对科技行为的“是非与善恶”进行道德评判,并向科技提出规范性的呼吁或指令,而不对伦理道德体系本身进行反思、修正与发展。

事实上,科技发展的许多重大问题,“已经不是传统的伦理道德框架能够提供某种有价值的答案,而需要对传统的伦理观念及其前提性规定进行批判反思”的基础上,才能做出有效的回答。具体到人工智能的道德评判问题,则需要对“人工智能是否是真正意义上的人格实体与道德实体”进行批判性反思,而不是在某些细枝末节问题上纠缠不清,否则对问题的实质把握及其根本性解决是无所助益的。

References:

[1]王银春, 人工智能的道德判断及其伦理建议. 南京师大学报(社会科学版), 2018(04): 第29-36页.

复旦大学教授王国豫老师长期从事高科技伦理问题的基础理论和应用对策研究,她是国家社会科学基金重大项目“高科技伦理问题研究”首席专家。她主张新时代科技下的伦理道德研究一方面要从现实维度出发,以问题意识为导向,指出现代技术对传统生命观的遮蔽。另一方面从技术伦理学的路径出发,强调技术中蕴含着价值,要从源头上阐清概念,制定规范,进而从伦理共同体、科学共同体走向行动共同体。

CNCC2019大会,特邀请演讲嘉宾王国豫老师作主题报告。开设“人工智能开发有道德边界么?”、“智能驾驶未来之路”等主题的分论坛,共同探讨人工智能的道德伦理的问题。

CNCC介绍:

CNCC2019由大会报告、大会论坛、技术论坛、活动、展览等环节组成,其中技术论坛数量最多,400多位精英为大会贡献的多场高质量论坛,吸引了国内外大量的学术、工业界人士参会,是计算前沿交流的舞台。更有前沿技术与应用的预测,以下是本次大会获评通过的CNCC2019技术论坛列表:

战略合作媒体